مقال | عندما تتنفس الخوارزميات ناراً: الذكاء الاصطناعي العسكري في حرب إيران 2026

“كنت أحدق في الشاشة أرى هدفاً محدداً بدائرة حمراء. لم يستغرق التحليل أكثر من 47 ثانية. في الماضي، كنا نحتاج أسبوعين لنقرر بنفس الدرجة من الثقة.”

هذه الشهادة التي نقلتها الغارديان عن ضابط استخبارات أمريكي شارك في الحملة ضد إيران، تلخّص اللحظة الفارقة التي يعيشها العالم اليوم. في مارس 2026.

لم يكن الشرق الأوسط يشهد حرباً تقليدية فحسب، بل كان مختبراً مفتوحاً لأخطر تقنية عرفتها البشرية: الذكاء الاصطناعي العسكري.

ما حدث في السماء الإيرانية لم يكن تطوراً تكتيكياً عابراً، بل كان زلزالاً استراتيجياً سيُعيد تشكيل ميزان القوى العالمي لعقود قادمة.

مشروع مافن : من قبو متواضع إلى عقل الحرب الرقمية

قبل تسع سنوات، كانت فكرة تعليم الآلة كيف ترى وتفهم وتقرر تبدو ضرباً من الجنون. بدأ مشروع مافن عام 2017 كمبادرة داخل البنتاغون تعتمد على تقنيات رؤية الحاسوب (Computer Vision) لتحليل مقاطع المراقبة الجوية وتصنيف الأهداف تلقائياً دون تدخل بشري مستمر.

تروي الصحفية الاستقصائية كاترينا مانسون في كتابها “مشروع مافن: عقيد في المارينز وفريقه وفجر حروب الذكاء الاصطناعي” الصادر عن دار Norton القصةَ الكاملة لهذا البرنامج، كاشفةً كيف سعى البنتاغون منذ سنوات لجلب عقول وادي السيليكون إلى غرف العمليات العسكرية.

بحلول يناير 2026، وصل الذكاء الاصطناعي العسكري إلى مرحلة النضج عبر اندماج مشروع مافن مع منصة بالانتير تحت مسمى “مافن الذكي” (Maven Smart System)، لينتج نظاماً يجمع بين التحليل الاستخباراتي الفوري وتوليد قوائم الاستهداف.

علاوة على ذلك، أصدرت وزارة الدفاع الأمريكية في يناير 2026 وثيقتها الرسمية “استراتيجية الذكاء الاصطناعي لوزارة الحرب“، التي تُقرّ صراحةً بأن الذكاء الاصطناعي بات مكوناً أساسياً لا أداةً مساعدة.

كيف يعمل مافن؟

يعتمد النظام على أربع مراحل متتالية:

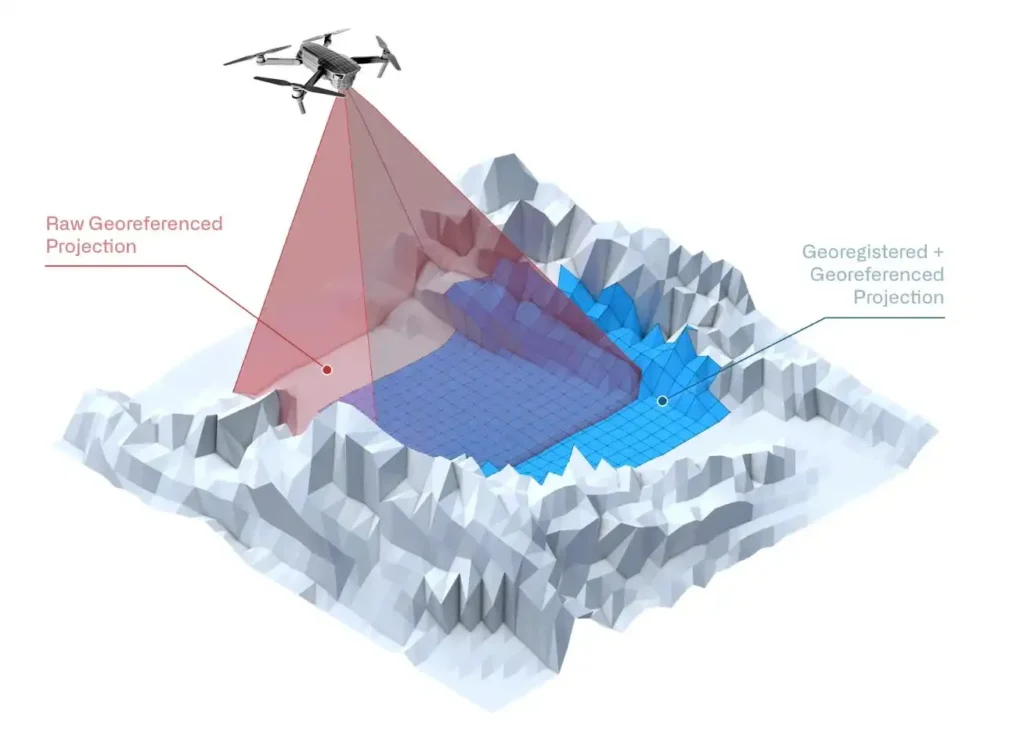

جمع البيانات — طائرات مسيّرة وأقمار اصطناعية تغذّي النظام ببيانات المراقبة لحظةً بلحظة

التحليل الأولي — شبكات عصبية عميقة (Deep Neural Networks) تفلتر البيانات وتصنّف الأهداف المحتملة

ربط الأنماط — الخوارزمية تكشف علاقات خفية بين تحركات الأهداف واتصالاتهم

التوصية والموافقة البشرية — يعرض النظام قائمة بالأهداف على ضابط مخابرات يملك صلاحية الموافقة النهائية

ألف هدف في أربع وعشرين ساعة

في الثامن والعشرين من فبراير 2026، انطلقت عملية “الغضب الملحمي” الأمريكية لتُثبت أن الذكاء الاصطناعي العسكري تجاوز مرحلة التجريب نحو التطبيق الفعلي الكامل.

كشف الجنرال براد كوبر قائد القيادة المركزية الأمريكية أن النظام استطاع معالجة البيانات الاستخباراتية في ثوانٍ معدودة لتحديد أكثر من ألف هدف خلال أربع وعشرين ساعة فحسب.

في حين احتفظ القادة البشريون بالقرار النهائي للموافقة على كل ضربة. وبالفعل، وفّرت هذه القدرة الحسابية الهائلة للمخططين العسكريين وتيرة تنفيذ كانت مستحيلة في حروب العقود الماضية.

استعانت القوات الأمريكية إلى جانب ذلك بطائرات B-2 وطائرات مسيّرة انتحارية لتنفيذ الضربات. وصف محلل في البنتاغون لبلومبرغ ما يفعله نظام مافن بقوله: “يشبه محاولة شرب مياه الأطلسي في جرعة واحدة، ثم إخبارك أين توجد أفضل الأسماك“.

كلود في غرفة العمليات : صراع البنتاغون وأنثروبيك

في قلب العملية العسكرية الأمريكية كان يعمل نموذج لغوي ضخم (LLM) يُعرف بـ”كلود” من تطوير شركة أنثروبيك، مدمجاً داخل منصة بالانتير لتخطيط الضربات ومعالجة الاستخبارات في إيران.

أكد مصدران مطّلعان على العمليات لـCBS News استخدامه رغم الجدل القانوني الدائر بين الشركة والبنتاغون. في المقابل، صرّح مدير البنتاغون التقني إيميل مايكل أن استخدام كلود شمل “تلخيص الوثائق وتحسين سلاسل اللوجستيات والإمداد“.

الخلاف الجوهري أشعل صداماً علنياً غير مسبوق: طالب البنتاغون بصلاحية استخدام كلود لـ”جميع الأغراض القانونية”، أما أنثروبيك فرفضت توظيف نموذجها في الأسلحة المستقلة الكاملة أو في مراقبة الأمريكيين جماعياً.

صرّح الرئيس التنفيذي لأنثروبيك داريو أمودي: “سعينا لرسم خطوط حمراء لأن تجاوزها يتعارض مع القيم الأمريكية. الخلاف مع الحكومة هو أكثر الأشياء أمريكيةً في العالم”.

وبالفعل، ردّ الرئيس دونالد ترامب بإصدار أمر يُلزم الوكالات الفيدرالية بالتوقف عن استخدام تقنيات أنثروبيك خلال ستة أشهر، فيما صنّف وزير الدفاع بيت هيغسث الشركة “خطراً على سلسلة التوريد الدفاعية”.

مدرسة الأطفال : عندما أخطأت الخوارزمية

لم تمر الضربات الأمريكية دون ثمن إنساني مؤلم. تحقق نيويورك تايمز في حادثة قصف مبنى إيراني تبيّن لاحقاً أنه كان مدرسة ابتدائية، وهو خطأ وصفه محللون بأنه ناجم عن تشابه الإشارات الإلكترونية الصادرة عن المبنى مع أنماط اتصالات عسكرية في قواعد بيانات النظام.

وعلى إثر ذلك، طالب أكثر من 120 عضواً في مجلس النواب وزيرَ الدفاع هيغسث بالإجابة عن سؤال محدد: “ما الدور الدقيق للذكاء الاصطناعي العسكري في اختيار ذلك الهدف وإجراء التقييم القانوني لمشروعيته؟“.

وثيقة الاستراتيجية : تغليف الحرب بأخلاقيات الذكاء الاصطناعي

في يناير 2026، نشرت وزارة الدفاع الأمريكية وثيقة “استراتيجية الذكاء الاصطناعي لوزارة الحرب” التي تعترف صراحةً بمبدأ “الإنسان في الحلقة” (Human-in-the-Loop)، أي وجوب موافقة بشرية على الضربات.

لكنها تُقرّ في الوقت ذاته بأن “سرعة التوصيات قد تتجاوز قدرة البشر على المراجعة الدقيقة“. تضمنت الوثيقة تخصيص 3.2 مليار دولار لتطوير أنظمة الذكاء الاصطناعي العسكري خلال 2026-2027، ودعوة صريحة لشركات التكنولوجيا للتعاون مع وعود بتسهيل الإجراءات التنظيمية.

ردّت افتتاحية الغارديان بنقد لاذع: “الوثيقة تحاول إضفاء شرعية أخلاقية على واقع وحشي. تقول إن الإنسان في دائرة القرار، لكنها تخلق نظاماً سريعاً لدرجة أن الإنسان لن يكون قادراً على فهمه، ناهيك عن مراجعته”.

وأضاف موقع The Conversation أن “أكبر كذبة في هذه الاستراتيجية هي فكرة الإنسان المسيطر؛ في اللحظة التي يصبح فيها النظام أسرع وأذكى من المشغل، يصبح البشر مجرد أختام مطاطية”.

آفاق الحروب الذكية : ماذا بعد إيران؟

لا ينفرد الجيش الأمريكي بهذا التوجه؛ تستخدم إسرائيل نظام “لافندر” (The Gospel) المدعوم بالذكاء الاصطناعي في عملياتها العسكرية منذ حرب غزة.

يُنذر هذا بدخول العالم حقبة جديدة من سباق التسلح الرقمي يتنافس فيه اللاعبون الكبار على أنظمة إدارة المعارك ذات الاستقلالية المتصاعدة.

يطرح موقع The Conversation سؤالاً قانونياً جوهرياً لا إجابة له حتى الآن: “من يُحاسَب عندما ترتكب الخوارزمية جريمة حرب؟ المبرمج؟ القائد العسكري؟ الشركة المصنّعة؟ أم الخوارزمية نفسها التي لا تملك شخصية قانونية؟”.

الإجابة الأمريكية الرسمية لا تزال غائبة، فيما خلصت صحيفة الغارديان إلى أن “حرب إيران تُعلن أن التحول النوعي قد بدأ فعلاً. السؤال لم يعد هل سيستخدم الجيش الذكاء الاصطناعي في الحروب، بل: من يضمن ألا تُقتل مدرسة أطفال في طريق الخوارزمية التالية؟”.

ما هو مشروع مافن الذكي؟

هو نظام ذكاء اصطناعي عسكري طورته وزارة الدفاع الأمريكية بالشراكة مع بالانتير، يعتمد على الشبكات العصبية العميقة لتحليل بيانات المراقبة وتحديد الأهداف العسكرية بسرعة فائقة.

كيف استُخدم نموذج كلود في حرب إيران 2026؟

اندمج النموذج داخل منصة بالانتير لمعالجة المعطيات الاستخباراتية وتوليد توصيات الاستهداف، مع احتفاظ القادة البشريين بسلطة القرار النهائي.

ما خطر التحيز الآلي في الحروب الذكية؟

هو ميل الجنود للثقة التلقائية بقرارات الخوارزمية دون مساءلتها، مما قد يُفضي إلى استهداف مواقع مدنية بسبب أخطاء في البيانات أو قصور في التدريب.

ما موقف شركة أنثروبيك من الاستخدام العسكري؟

رفضت أنثروبيك استخدام كلود في الأسلحة المستقلة الكاملة ومراقبة الأمريكيين، مما أشعل نزاعاً مع البنتاغون وأفضى إلى قرار ترامب بإيقاف استخدام تقنيات الشركة في الوكالات الفيدرالية.